IT之家 4 月 30 日消息,蚂蚁集团旗下的百灵大模型今日宣布,今天将 Ling-2.6-1T 正式开源。

官方表示,Ling-2.6-1T 并不是为了单纯追求更长的思考链,或制造更强的“参数规模体感”,而是面向真实复杂任务,系统性优化模型的智效比、指令执行、工具适配、长上下文承接和工程任务处理能力。该模型重点解决三个问题:

在更低 Token 开销下保持强综合智能:依托 MLA 与 Linear Attention 的 Hybrid 架构创新,结合抑制“过程冗余”的强化奖励策略,Ling-2.6-1T 在保持 1T 参数能力上限的同时,减少对冗长思考链的依赖,以更高效的“快思考”机制直达结果,从而压缩同等智能水平下的输出成本。

在复杂任务中实现更可靠的多步执行:在 Agent、Coding 和工作流场景中,模型需要的不只是单点回答能力,而是对指令、工具、上下文和中间状态的持续把控,在噪声环境下的推理与精准作答。Ling-2.6-1T 加强对复合型任务的学习,在 AIME26、SWE-bench Verified、BFCL-V4 、TAU2-Bench、IFBench 等执行类基准上达到开源 SOTA 水平,展现出面向复杂任务的综合执行能力。

让万亿级模型真正进入开发者和企业的生产工作流:Ling-2.6-1T 具备从代码生成到缺陷修复的完整工程落地能力,并与主流 Agent 框架高度兼容,适用于多工具、多步骤、多约束的复杂场景。它的目标不是停留在单次演示,而是成为真实业务系统中可部署、可协同、可持续运行的模型能力底座。

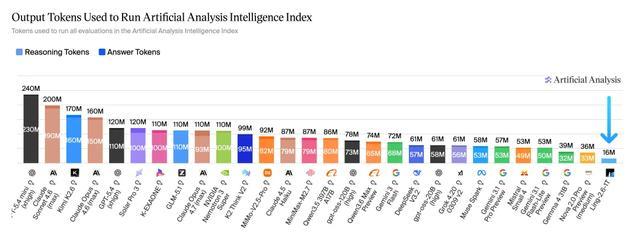

Ling-2.6-1T 以 16M tokens 完成 Artificial Analysis 完整评测

官方还表示,为支持更多开发者体验与评测 Ling-2.6-1T,将 OpenRouter 平台的免费 API 调用服务延期一周。

IT之家附开源链接如下:

Hugging Face:

ModelScope:https://file.tonglife.net/images/2a/37df6ad5d73d2c4c7d46cef119ae28.jpg

本文转自:凤凰网科技

原文地址: https://tech.ifeng.com/c/8sjwEV7NT9P

小同爱分享2 个月前

疫情,就是让人抑郁,又没了感情。 - 小同爱分享

小同爱分享3 个月前

所谓生活不如意,就是缺少人民币。 - 小同爱分享